[LG Aimers] 지도학습(분류/회귀)3 - Linear Classification

LG Aimers 학습 내용을 정리한 글입니다.

1. Linear Classification

고려사항 1. Whitch predictor? Hypothesis class

고려사항 2. How good is a predictor? Loss function

- Zero-one loss

- Hinge loss

- Cross-entropy loss

고려사항 3. How to compute the best predictor? Optimization algorithm

- Gradient descent algorithm

Score and Margin

score : 결정과정에서 model이 얼마나 confident한지 측정가능한 지표.

margin : score 값에 y를 곱해 계산하여, 모델이 얼마나 정확한지 측정가능한 지표.

Zero-one loss : gradient descent 값이 0이 되는 경우가 발생해 학습을 제대로 진행할 수 없다.

Hinge loss : margin이 1보다 작으면 error가 발생하고, 1보다 클 경우 error가 없는 것으로 여긴다.

Cross-entropy loss : 가장 많이 사용, p와 q의 값이 유사한지에따라 error의 정도가 바뀌는 특징을 가진다. 유사할 경우 loss가 감소하고, 유사하지 않을 경우 loss가 증가한다.

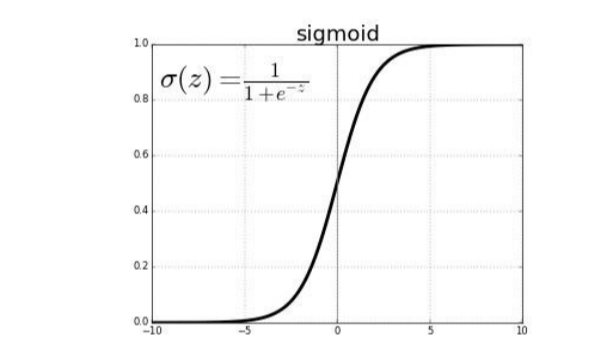

Sigmoid function: 0일 때 1/2의 값을, 양의 값으로 다다르면 1에 가까워지고 음의 값으로 다다르면 -1에 가까워지는 특징의 함수로 score 값을 sigmoid 함수에 넣어 0~1 사이로 매핑한다. → logistic model

Training a linear classifier: Iterative optimization using dradient descent

학습단계 1. Initialize weightes at time step

학습단계 2. Compute the gradients

학습단계 3. Set the direction to move

학습단계 4. Update weights

학습단계 5. Iterate to next step until converging

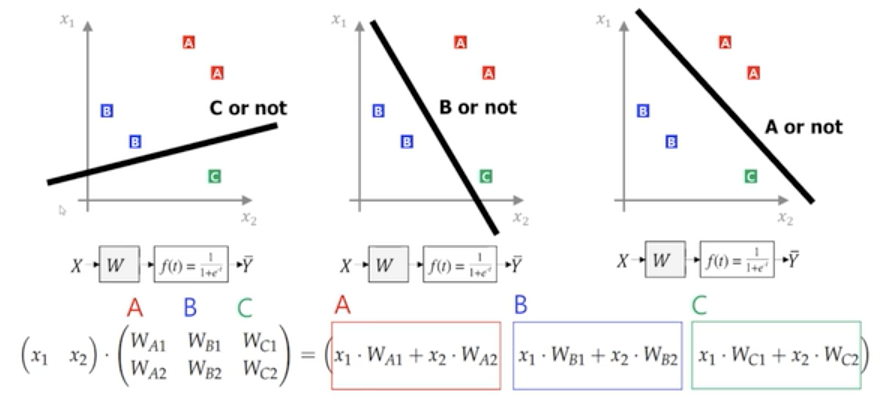

Multiclass classification

One-VS-All

One Hot Encoding : 두 개의 서로 다른 표 사이에 거리를 가깝게 하면서 학습, label을 지정할 때 사용